| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | 7 |

| 8 | 9 | 10 | 11 | 12 | 13 | 14 |

| 15 | 16 | 17 | 18 | 19 | 20 | 21 |

| 22 | 23 | 24 | 25 | 26 | 27 | 28 |

| 29 | 30 | 31 |

- rotary position embedding

- gqa

- context engineering

- Engineering at Anthropic

- catastrophic forgetting

- attention

- PEFT

- reinforcement learning from human feedback

- self-attention

- CoT

- Embedding

- SK AI SUMMIT 2025

- BLEU

- 토크나이저

- test-time scaling

- model context protocol

- MQA

- extended thinking

- re-ranking

- Langchain

- 트랜스포머

- Multi-Head Attention

- chain-of-thought

- RLHF

- fréchet inception distance

- langgraph

- transformer

- MHA

- flashattention

- Positional Encoding

- Today

- Total

AI Engineer 공간 "사부작 사부작"

LoRA와 QLoRA: 거대 언어 모델을 내 손안에 맞추는 마법, PEFT 파헤치기 본문

LoRA와 QLoRA: 거대 언어 모델을 내 손안에 맞추는 마법, PEFT 파헤치기

ChoYongHo 2025. 5. 18. 13:19거대 모델을 내 손안에: LoRA와 QLoRA로 똑똑하게 모델 경량화하기

인공지능, 특히 거대 언어 모델(LLM)은 우리 삶에 빠르게 스며들고 있습니다. 방대한 데이터를 학습하여 다양한 작업을 수행할 수 있지만, 특정 분야나 작업에 딱 맞게 활용하려면 추가적인 조정, 즉 '파인튜닝(fine-tuning)'이 필요합니다. 하지만 LLM의 모든 파라미터를 다시 학습시키는 '풀 파인튜닝(Full Fine-tuning)'은 마치 도시 전체를 재개발하는 것처럼 막대한 계산 자원과 비용, 그리고 시간을 요구합니다. 게다가 기존에 학습했던 지식을 쉽게 잊어버리는 '치명적 망각(catastrophic forgetting)' 현상도 발생할 수 있습니다. 이러한 문제를 해결하기 위해 등장한 것이 바로 파라미터 효율적 파인튜닝(Parameter-Efficient Fine-tuning, PEFT)입니다. PEFT는 모델 전체가 아닌, 아주 작은 부분만 수정하여 특정 작업에 맞게 모델을 최적화하는 방법론입니다. 마치 건물의 기본 골격은 그대로 두고, 특정 용도에 맞게 일부 인테리어만 변경하는 것과 같죠. 이를 통해 파인튜닝에 필요한 시간과 비용을 획기적으로 줄일 수 있습니다.

이번 글에서는 대표적인 PEFT 기법인 LoRA와, 이를 더욱 발전시킨 QLoRA에 대해 자세히 알아보겠습니다. 이 기술들이 어떻게 거대 모델을 우리 손안의 도구처럼 다룰 수 있게 해주는지, 그 원리와 장점, 그리고 해결하는 문제들을 쉽고 재미있게 살펴보겠습니다.

LoRA (Low-Rank Adaptation): 핵심만 콕 집어 효율적으로 학습하기

LoRA(Low-Rank Adaptation of Large Language Models)는 마이크로소프트에서 발표한 PEFT 방법 중 하나로, 가장 널리 사용되는 기법 중 하나입니다. LoRA의 핵심 아이디어는 "사전 학습된 거대 모델의 원래 가중치(W)는 그대로 두고, 아주 작은 규모의 추가 파라미터만 학습시켜 변화를 주자"는 것입니다.

LoRA의 작동 원리

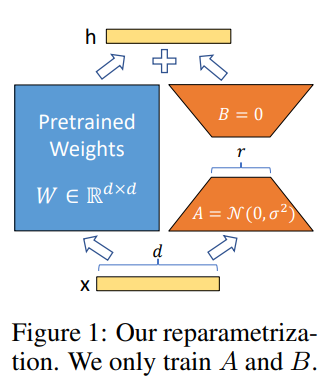

LoRA는 기존 모델의 특정 계층(주로 어텐션 계층)에 학습 가능한 '어댑터(adapter)'를 추가합니다. 이 어댑터는 원래 가중치 행렬의 변화량(ΔW)을 근사하는 역할을 합니다. 흥미로운 점은 이 변화량 ΔW를 직접 학습하는 대신, 두 개의 훨씬 작은 저차원(low-rank) 행렬 A와 B의 곱(ΔW ≈ BA)으로 표현한다는 것입니다. 파인튜닝 시에는 원래 모델의 가중치 W는 고정(frozen)된 상태로 두고, 이 작은 어댑터 행렬 A와 B만 학습합니다.

- 개념: 기존 모델의 가중치 행렬(W)에 변화를 주는 대신, 작은 두 행렬(A, B)을 추가하여 이들만 학습합니다. 최종적으로 모델의 출력은 원래 가중치(W)와 학습된 변화량(BA)을 더한 값(W + BA)을 통해 계산됩니다.

- 비유: LoRA는 마치 학생이 시험공부를 할 때, 이미 잘 알고 있는 내용은 건드리지 않고, 시험에 나올 핵심 내용이나 부족한 부분만 집중적으로 요약 정리(작은 행렬 A, B)하여 기존 지식에 추가하는 것과 같습니다. 이렇게 하면 전체 교과서를 다시 공부하는 것보다 훨씬 효율적으로 성적을 올릴 수 있겠죠.

- 예시: 이미지 생성 AI인 Stable Diffusion에서 LoRA는 특정 캐릭터나 화풍을 학습시키는 데 널리 활용됩니다. 전체 이미지 생성 모델을 다시 학습할 필요 없이, LoRA 어댑터만 추가하여 원하는 스타일의 이미지를 빠르고 효율적으로 생성할 수 있습니다. 또한, 챗봇이 새로운 대화 스타일이나 특정 주제에 대해 더 잘 응답하도록 기존 언어 모델을 조정할 때도 LoRA를 사용하면 기존 지식을 유지하면서 빠르게 적응시킬 수 있습니다.

LoRA의 장점

- 학습 파라미터 대폭 감소: 전체 모델 파라미터의 극히 일부(예: 0.01%)만 학습하므로 학습 속도가 빠르고 계산 비용이 적게 듭니다. GPT-3 175B 모델의 경우 학습 가능한 파라미터 수를 10,000배 줄일 수 있습니다.

- GPU 메모리 절약: 학습해야 할 파라미터가 적어 GPU 메모리 요구량이 3배까지 줄어듭니다.

- 기존 지식 보존 (Catastrophic Forgetting 완화): 원래 모델의 가중치를 변경하지 않기 때문에 기존에 학습된 지식을 비교적 잘 보존합니다.

- 추론 시 추가 지연 없음: 학습된 어댑터 행렬은 원래 가중치와 통합될 수 있어, 추론 시 추가적인 계산 지연이 발생하지 않습니다.

- 다양한 작업에 대한 어댑터 교체 용이: 하나의 사전 학습 모델에 대해 여러 작업별 LoRA 어댑터를 학습시켜 놓고, 필요에 따라 교체하며 사용할 수 있어 유연성이 높습니다.

QLoRA (Quantized LoRA): 한계를 넘어선 경량화, 더 적은 자원으로 더 많은 가능성을

QLoRA(Quantized LoRA)는 LoRA의 아이디어를 더욱 발전시켜 메모리 사용량을 극한까지 줄인 혁신적인 기법입니다. QLoRA의 핵심은 "사전 학습된 거대 모델의 가중치를 매우 낮은 정밀도로 양자화(quantization)하여 메모리에 올리고, LoRA 어댑터만 고정밀도로 학습하자"는 것입니다.

QLoRA가 해결하는 문제와 작동 원리

LoRA가 이미 훌륭한 경량화 기법이지만, 수백억 개 이상의 파라미터를 가진 초거대 모델을 파인튜닝하기에는 여전히 많은 메모리가 필요합니다. QLoRA는 이러한 문제를 해결하기 위해 등장했습니다.

- 양자화(Quantization)란?

- 개념: 모델의 가중치나 활성화 값을 표현하는 데 사용되는 비트 수를 줄이는 기술입니다. 예를 들어, 일반적으로 32비트 또는 16비트로 표현되는 숫자를 8비트나 4비트와 같이 더 적은 비트로 표현하는 것입니다.

- 비유: 고해상도 사진 파일의 크기를 줄이기 위해 압축하는 것과 비슷합니다. 압축을 통해 파일 크기는 작아지지만, 사진의 중요한 정보는 최대한 유지하려고 노력하는 것이죠. 양자화도 정보 손실을 최소화하면서 모델 크기를 줄이는 것이 목표입니다. 또는 소수점 아래 많은 자리까지 계산하던 것을, 정확도에 큰 영향이 없는 선에서 소수점 자리를 줄여서 계산하는 것과 유사하다고 볼 수 있습니다.

- QLoRA의 핵심 아이디어: QLoRA는 사전 학습된 모델의 가중치를 4비트와 같이 매우 낮은 정밀도로 양자화하여 GPU 메모리에 로드합니다. 이렇게 하면 모델을 불러오는 데 필요한 메모리 양이 획기적으로 줄어듭니다. 중요한 점은, 그래디언트 계산은 이 양자화된 가중치를 통해 이루어지지만, 실제 가중치 업데이트는 여전히 더 높은 정밀도(예: 16비트 BFloat16)로 유지되는 작은 LoRA 어댑터에만 적용된다는 것입니다.

- QLoRA의 추가 혁신 기술: QLoRA는 성능 저하 없이 메모리를 절약하기 위해 다음과 같은 기술들을 함께 사용합니다.

- 4-bit NormalFloat (NF4): 일반적인 가중치 분포인 정규분포(가우시안 분포)에 정보 이론적으로 최적화된 새로운 4비트 데이터 타입입니다. 기존 양자화 방식보다 정보 손실을 줄여 성능을 유지하는 데 도움을 줍니다.

- 이중 양자화 (Double Quantization): 양자화 과정에서 사용되는 양자화 상수(quantization constants) 자체를 다시 한번 양자화하여 메모리 사용량을 더욱 줄입니다. 마치 압축된 파일을 한 번 더 압축하는 것과 같지만, 정보 손실에 유의해야 합니다.

- 페이지드 옵티마이저 (Paged Optimizers): 파인튜닝 과정에서 순간적으로 메모리 사용량이 급증하는 '메모리 스파이크(memory spikes)' 현상을 관리합니다. CPU 메모리와 GPU 메모리 간의 데이터 페이징을 통해 이러한 문제를 해결하여 안정적인 학습을 가능하게 합니다.

QLoRA의 효과

- 극적인 메모리 절감: QLoRA를 사용하면 650억 파라미터 모델(예: LLaMA 65B)도 단일 48GB GPU에서 파인튜닝할 수 있을 정도로 메모리 사용량을 크게 줄일 수 있습니다.

- 고성능 유지: 메모리 사용량을 크게 줄이면서도 16비트 풀 파인튜닝 수준의 성능을 유지하는 것을 목표로 합니다.

- LLM 접근성 향상: 이전에는 수많은 고성능 GPU가 필요했던 거대 모델의 파인튜닝을 상대적으로 저렴한 단일 소비자용 GPU에서도 가능하게 만들어, 학계나 중소규모 기업에서도 LLM 연구 및 개발의 문턱을 크게 낮추었습니다.

마무리하며

LoRA와 QLoRA는 거대 언어 모델이라는 무거운 갑옷을 벗고, 우리 손에 꼭 맞는 가볍고 날렵한 도구를 쥐여준 것과 같습니다. 마치 전문 산악인만 오를 수 있었던 험준한 산에 잘 닦인 등산로를 놓아, 더 많은 사람이 정상에 도전하고 새로운 풍경을 발견할 기회를 열어준 것과 비견될 수 있습니다.

- LoRA는 기존 모델의 지혜는 보존하며, 새로운 작업에 필요한 핵심만 빠르게 학습하는 ‘선택과 집중’의 미학

- QLoRA는 극한의 메모리 다이어트를 통해 스마트폰으로 고사양 게임을 즐기듯, 제한된 자원에서 거대 모델을 다룰 수 있는 길

파라미터 효율적 파인튜닝(PEFT) 기법 덕분에 막대한 자본이나 인프라 없이도 아이디어와 데이터만 있다면 누구나 자신만의 특화된 AI 모델을 개발하고 활용할 수 있게 되었습니다. 이는 개인 맞춤형 AI 비서에서 특정 산업에 최적화된 전문 AI 솔루션까지, 인공지능이 우리 삶과 산업 곳곳에 더욱 깊숙이 자리 잡을 수 있는 기반을 다지는 일입니다. LoRA와 QLoRA의 등장은 앞으로 더 다채롭고 혁신적인 AI 서비스가 펼쳐지는 데 핵심적인 역할을 할 것입니다.

LoRA: Low-Rank Adaptation of Large Language Models

An important paradigm of natural language processing consists of large-scale pre-training on general domain data and adaptation to particular tasks or domains. As we pre-train larger models, full fine-tuning, which retrains all model parameters, becomes le

arxiv.org

https://arxiv.org/abs/2305.14314

QLoRA: Efficient Finetuning of Quantized LLMs

We present QLoRA, an efficient finetuning approach that reduces memory usage enough to finetune a 65B parameter model on a single 48GB GPU while preserving full 16-bit finetuning task performance. QLoRA backpropagates gradients through a frozen, 4-bit quan

arxiv.org

'Theory > Training & Fine-Tuning' 카테고리의 다른 글

| AI의 네버 엔딩 학습 스토리: 망각의 저주를 풀고 끊임없이 진화하는 비결 (0) | 2025.05.19 |

|---|---|

| 모델 병합(Model Merging): 여러 두뇌를 하나로 합치는 AI 연금술 (0) | 2025.05.19 |

| AI 추론 능력의 비밀, RLHF와 RLVR: DeepSeek-R1은 어떻게 '생각'을 배웠나? (0) | 2025.05.17 |

| RLHF 보상 모델 설계의 비밀: 인간 선호를 정확히 읽는 AI의 나침반 (0) | 2025.05.17 |

| AI 조율의 미학: RLHF부터 GRPO까지, LLM 정렬 기법 별 핵심과 선택 전략 (0) | 2025.05.17 |